MCP (Model Context Protocol): почему это «USB-C для ИИ» и как подключать любые инструменты

ИИ быстро эволюционирует: от простых чат-интерфейсов к полноценным агентам, способным выполнять сложные задачи — искать информацию, анализировать данные и запускать процессы. Но чтобы такие системы действительно работали, им необходим доступ к внешним инструментам и удобный способ взаимодействия с ними. Эту задачу решила компания Anthropic. В статье разберем расшифровку MCP, объясним, зачем он нужен и как помогает ИИ работать с внешними сервисами без сложных интеграций.

Содержание

Что такое MCP и зачем он нужен

Когда-то у каждого устройства был свой разъем: зарядки не подходили, кабели терялись. Заряжать ноутбук и телефон с помощью одного и того же провода было невозможно. Потом появился USB-C — единый стандарт, который упростил жизнь. С инструментами для ИИ происходило примерно то же самое. Модели есть, сервисы есть, но универсального «разъема» не хватало. В 2024 году это изменилось.

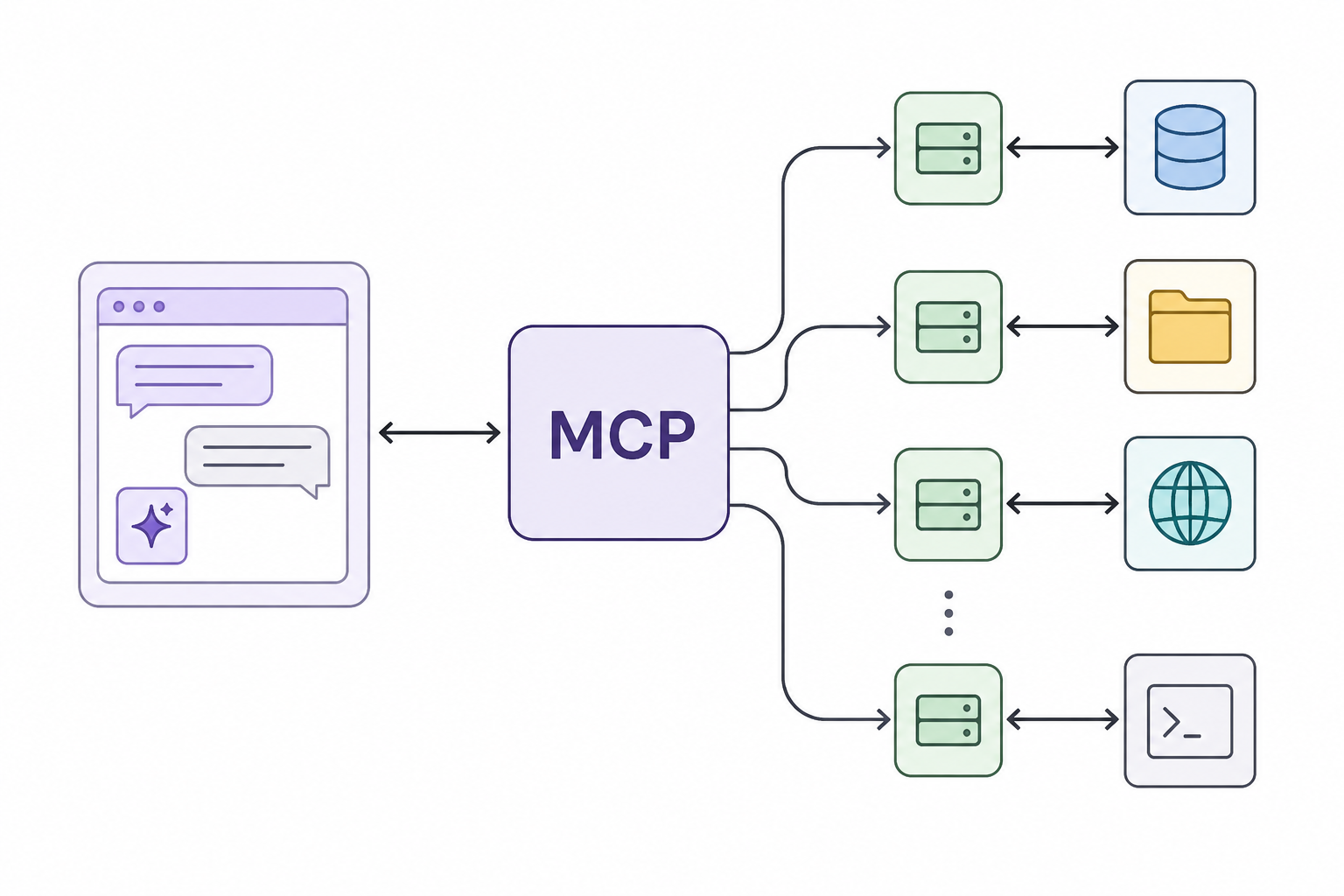

MCP (Model Context Protocol) — это открытый протокол, созданный компанией Anthropic. Он стандартизирует, как ИИ-модели получают доступ к инструментам и внешним данным. Проще говоря, это единый способ подключать к модели любые сервисы: базы данных, API, файлы, веб-сервисы.

Стандарт решает три ключевые задачи:

- описывает, какие инструменты доступны модели;

- задает формат, в котором модель может их вызывать;

- стандартизирует обмен данными между моделью и внешним миром.

Чтобы научить модель работать с конкретным инструментом, разработчику приходится писать отдельную интеграцию. Для CRM — один код, для базы данных — другой, для корпоративного портала — третий. Либо можно один раз создать MCP-сервер для вашего инструмента, после чего любой ИИ-клиент, поддерживающий протокол, автоматически получает возможность этим инструментом пользоваться.

Протокол описывает единый формат запросов, единую структуру ответов и четкие правила, как модель может узнавать о доступных инструментах, вызывать их и получать результаты. Это делает интеграцию предсказуемой и масштабируемой.

Если хотите быстрее перейти от теории к рабочим сценариям, приходите на практикум «RAG-боты и агенты LLM (большие языковые модели)». Курс длится две недели и подходит для начинающих. Здесь учат создавать ИИ-инструменты, которые помогают в работе. В программе есть отдельный блок, где разбирают, как подключать готовые инструменты (например, получать данные через API) и как в этом контексте работают AI-агенты и MCP. Это помогает понять, как протокол используется в реальных задачах.

Альтернативы Model Context Protocol

До этого подхода уже были рабочие решения. Все они позволяют моделям вызывать внешние функции, но делают это по-разному. У каждой альтернативы есть сильные стороны и принципиальные ограничения.

MCP или Function Calling (OpenAI)

Function Calling — это способ для модели самой решить, когда и какой инструмент вызвать. Разработчик описывает функции в виде JSON-схемы, передает их в запросе к API, а модель возвращает структурированный ответ: «вызвать функцию X с параметрами Y».

Это просто и совместимо с моделями OpenAI. Но есть три ограничения.

- Привязка к экосистеме OpenAI. Вы не сможете использовать тот же набор функций с Claude, Llama или локальной моделью без переписывания кода.

- Функция живет внутри одного запроса — нет сессии, нет возможности выстроить цепочку действий без внешней логики.

- При большом количестве инструментов описание всех функций начинает съедать токены, а модель может ошибаться в выборе.

Model Context Protocol работает иначе. Это не встроенная функция конкретной модели, а отдельный протокол. Сервер сам сообщает клиенту, какие инструменты предоставляет, как их вызывать и какие параметры ожидать. Модель не зашивает описание инструмента в свой промпт, а получает его динамически. И главное: один MCP-сервер для искусственного интеллекта может обслуживать любую модель, которая понимает протокол.

MCP или OpenAPI + GPTs

OpenAPI (ранее Swagger Specification) — это стандарт описания REST API. Многие сервисы публикуют OpenAPI-спецификации, а платформы вроде GPTs от OpenAI умеют их читать и превращать в набор действий для модели.

Проблема в том, что OpenAPI описывает API для человека или для генерации кода, но не для ИИ-агента в реальном времени. В спецификации нет понятий «сессия», «авторизация в процессе диалога», «подтверждение опасного действия». GPTs пытается это эмулировать, но всегда есть риск, что модель вызовет деструктивный API-метод без лишних вопросов. Кроме того, OpenAPI не предполагает двухсторонней коммуникации: модель только вызывает, но не может получить стриминг данных или дождаться события от сервера.

Model Context Protocol изначально проектировался под агентный подход. Это особенно заметно в многоагентных системах, где несколько ИИ-компонентов взаимодействуют друг с другом и с внешними инструментами. Здесь встроены механизмы для подтверждения действий, управления сессией и передачи контекста между вызовами. Протокол не просто описывает, как вызвать метод, а определяет, как модель и инструмент общаются в процессе задачи.

MCP или LangChain

LangChain — фреймворк для создания приложений на основе LLM. Он предоставляет готовые компоненты: цепочки вызовов, шаблоны промптов, интеграции с базами данных и API. Но это библиотека, а не стандарт.

Если вы пишете приложение на LangChain и подключаете инструмент через класс Tool, этот инструмент будет работать только внутри вашего LangChain-приложения. Другой разработчик на чистом OpenAI API или Go не сможет взять вашу настройку — придется писать свою обвязку.

MCP — это протокол. Он работает поверх любых языков и фреймворков. Ваш MCP-сервер на Python может вызываться клиентом на Rust или даже консольной утилитой.

Например, сервер с инструментом «get_weather» (Python/Flask) подключается к Claude (MCP-клиент Anthropic), Llama (via Ollama+MCP) или кастомному агенту на Go — без переписывания.

Архитектура Model Context Protocol (MCP)

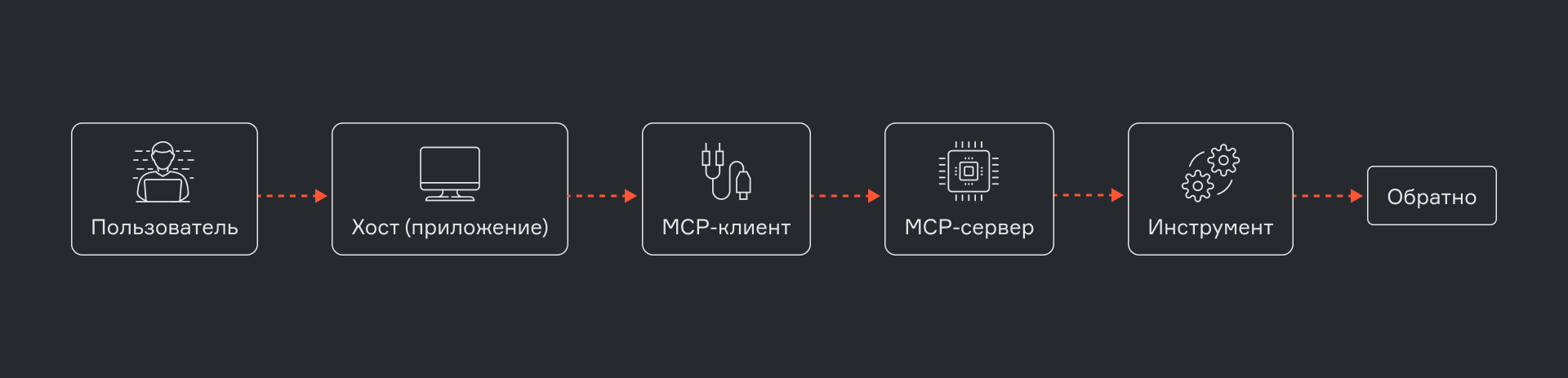

В протоколе выделяют четыре ключевых элемента: хост, клиент, сервер и инструменты.

Хост — это приложение, в котором работает ИИ-агент. Например, десктопный клиент Claude, IDE с плагином AI или ваш собственный чат-бот, запущенный на сервере. Хост управляет всем процессом: отвечает за пользовательский интерфейс, инициирует диалог с моделью и решает, когда и какие MCP-сервера подключать.

Клиент — это код внутри хоста, который говорит на языке MCP. Он устанавливает соединение с MCP-сервером, отправляет запросы, получает ответы и передает их обратно модели. В простых сценариях клиент и хост могут быть неразличимы, но технически это разные слои: хост — это контекст, клиент — это реализация протокола.

Сервер — это программа, которая предоставляет инструменты. Она запускается отдельно (локально или удаленно) и ждет подключения от MCP-клиента. Сервер при запуске сообщает: «Я умею делать вот это, для этого нужны такие параметры, а результат будет выглядеть так». Клиент получает этот список и передает модели.

Инструменты — это конкретные функции, которые сервер предоставляет: получить погоду, записать файл на диск, отправить email, выполнить SQL-запрос. Каждый инструмент имеет имя, описание, схему входных параметров и формат ответа.

Между вызовами инструментов сервер может сохранять состояние. Например, если модель сначала авторизовалась в API, а потом вызывает методы, сервер помнит сессию. Это позволяет строить цепочки действий, а не просто одноразовые запросы.

Протокол не диктует, как именно передавать данные — это может быть локальный процесс через stdio, HTTP, WebSocket или любой другой транспорт. Главное, чтобы хост и сервер понимали единый формат сообщений.

Как написать свой MCP-сервер

Если вы хотите понять, как сделать MCP на практике, лучший способ — написать простой сервер своими руками. Теория становится понятнее, когда виден код. Идея проста: вы берете любую функцию (например, получить погоду, найти клиента, посчитать метрику) и «оборачиваете» ее в инструмент, который может вызвать модель.

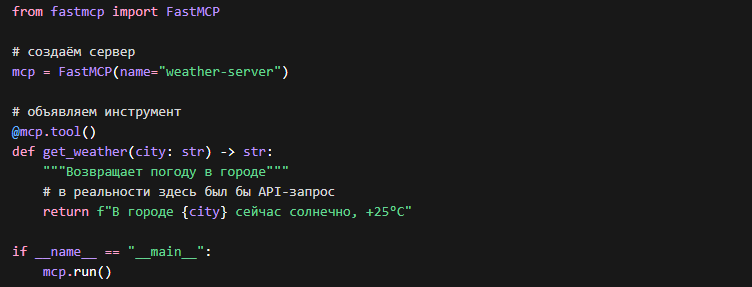

Простейший сервер на Python с FastMCP

FastMCP — это легковесная библиотека от Anthropic, которая скрывает детали протокола и позволяет сосредоточиться на логике инструментов.

Предположим, у нас есть простая функция: вернуть погоду по городу. Сделаем из нее MCP-инструмент.

Что происходит:

- FastMCP поднимает сервер.

- Декоратор @mcp.tool() превращает обычную функцию в инструмент.

- Описание (docstring) используется моделью как подсказка, когда вызывать этот инструмент.

- Параметры функции автоматически становятся входными параметрами инструмента.

После запуска сервер становится доступен MCP-клиенту, и модель может вызывать get_weather, если это уместно в контексте запроса.

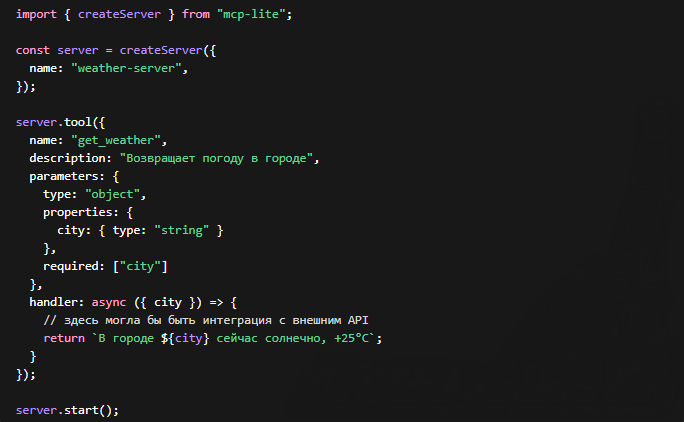

Простейший сервер на TypeScript с mcp-lite

В мире JavaScript и TypeScript тоже есть инструменты для работы с MCP. mcp-lite — минималистичная библиотека, которая не тащит лишних зависимостей.

Важно:

- инструмент описывается явно: имя, параметры, описание;

- handler — это функция, которая будет вызвана сервером;

- структура параметров обычно задается через JSON Schema.

В итоге вы получаете простой, но мощный механизм: любую бизнес-логику можно превратить в инструмент и «подключить» к ИИ так же легко, как подключить устройство через USB.

А дальше все зависит от задачи: вы можете расширять сервер, добавлять новые инструменты и постепенно усложнять настройки MCP под свои сценарии — от простых запросов к данным до полноценной автоматизации процессов.

Вопрос безопасности: где хранятся ваши данные

Model Context Protocol сам по себе не хранит данные. Это не облачный сервис и не база. Это стандарт, который описывает, как компоненты обмениваются информацией. Все зависит от того, как вы построили систему.

1. На уровне хоста. Приложение, которое запускает MCP-клиента (например, Claude Desktop), отвечает за то, к каким серверам подключаться и с какими правами. Вы сами указываете в конфигурации: запустить сервер weather.py с правами текущего пользователя. Хост не отправляет ваши данные в облако — MCP-серверы по умолчанию работают локально, на вашей машине.

2. На уровне сервера. Разработчик MCP-сервера сам решает, как обрабатывать конфиденциальные данные. Если серверу нужен API-ключ для доступа к внешнему сервису, он может:

- читать его из переменных окружения на вашей машине;

- запрашивать у пользователя через интерактивный диалог (протокол поддерживает запросы подтверждения);

- использовать системные хранилища секретов (Keychain, Secret Service).

MCP не требует, чтобы вы передавали секреты через сам протокол.

Когда модель вызывает инструмент, результат выполнения, например, содержимое файла или строка из базы данных, отправляется обратно в контекст модели. Это означает, что модель «увидит» эти данные в рамках текущей сессии. Нужно понимать, что модель — не изолированная песочница. Если вы работаете через API стороннего провайдера (Anthropic, OpenAI), данные в теории могут логироваться провайдером.

Рекомендация

Не передавайте через MCP-инструменты чувствительные данные в окружениях, где вы не контролируете хранение логов. Лучшая практика с MCP — давать каждому серверу ровно те права, которые ему необходимы. Если сервер нужен только для чтения файлов из одной папки — не давайте ему доступ ко всему диску. Если инструмент вызывает внешнее API — используйте отдельный аккаунт с ограниченными правами. Model Context Protocol позволяет запускать каждый сервер в отдельном процессе, что упрощает изоляцию.

Реальные сценарии использования

Лучший способ понять, почему MCP вообще появился — посмотреть на реальные задачи, где он дает ощутимое упрощение.

Сценарий 1. Работа с локальными файлами и документацией

Представьте, что вы хотите задать модели вопрос по внутренней документации вашей компании.

- Без MCP: документы приходится вручную копировать в контекст или строить RAG-систему.

- С MCP: вы подключаете папку с файлами как сервер, и модель сама ищет нужные фрагменты.

Пример: «Найди описание API авторизации» — сервер находит нужный markdown-файл, модель формирует ответ.

Сценарий 2. Управление базами данных по запросу

Бизнес-пользователь пишет: «Покажи мне топ-10 клиентов по сумме заказов за последний месяц». Без MCP эту задачу решают либо через готовый дашборд, либо через аналитика, который пишет SQL-запрос. А с MCP: модель сама формирует запрос, сервер выполняет его (обычно в read-only режиме) и возвращает результат.

Пример: «Топ-10 клиентов за месяц» — модель → SQL → сервер → ответ.

Сценарий 3. Цепочки действий с памятью между шагами

- Без MCP: нужно вручную связывать вызовы API в коде.

- С MCP: сервер может хранить контекст между шагами.

Цепочка строится естественно, без ручного склеивания промежуточных результатов.

Что в итоге и с чего начать

Мы разобрали, что такое Model Context Protocol, — единый стандарт подключения внешних инструментов к ИИ-агентам, своего рода «USB-C для ИИ». Узнали, чем MCP отличается от Function Calling, OpenAPI и LangChain: главное преимущество — совместимость между разными моделями и языками программирования. Рассмотрели архитектуру: хост (приложение, где живет агент), клиент (реализация протокола), сервер (поставщик инструментов) и сами инструменты. Поняли, что MCP-сервер — это компонент, который дает ИИ доступ к данным и действиям: файлам, базам, API, чему угодно. Затронули вопросы безопасности: данные остаются под вашим контролем, серверы работают локально.

Как установить и настроить MCP уже сегодня:

- Попробовать готовое. Установите Claude Desktop и пропишите в конфигурации любой community-сервер из репозитория modelcontextprotocol/servers. Убедитесь, что модель видит инструменты.

- Написать свой первый сервер. Возьмите Python с FastMCP или TypeScript с mcp-lite — буквально 10–15 строк кода, и у вас есть рабочий протокол.

- Изучить реальные сценарии. Попробуйте подключить сервер к локальной базе данных или файловой системе, дайте модели возможность искать и анализировать.

Если хотите уверенно интегрировать MCP в проекты и разобраться с AI-агентами на профессиональном уровне, то присмотритесь к курсу, о котором мы говорили выше.